티스토리 뷰

이제 basis에 대해 배워볼 것이다. 앞 장에서 언급했듯이 minimal spanning set of V를 V의 basis라고 한다. 그리고 여기서 basis는 dimension에 해당한다.

이를 풀어쓰면 다음과 같다.

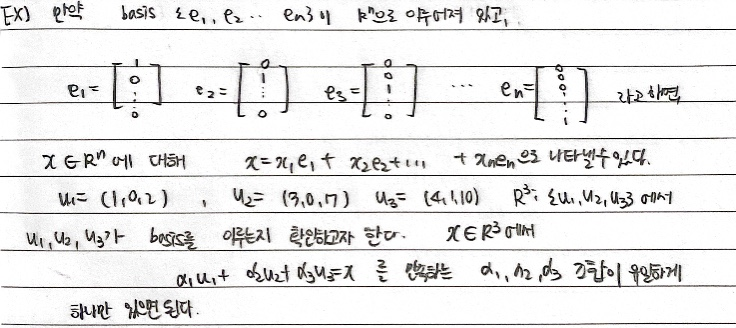

\(F\) vector space \(V\)에 대해 \(u_1, u_2, \cdots u_n\)이 \(V\)에 속한다고 하자. 만약 \(u_1, u_2, \cdots u_n\) spans V이며 linearly independent하면, 이는 \(V\)의 basis이다.

전 장의 이론 26에서 얘기한 바는 \(V\)의 선형 결합 조합이 오직 하나밖에 없으면은 Linearly independent임을 얘기했었다. 여기서 Linearly independent한 \({u_1, u_2 \cdots u_n}\)은 위의 정의에 의해 \(V\)의 basis가 된다.

교재에서는 다음과 같이 얘기하며, 증명은 이론 26 증명에 의해 성립한다.

F-vector space \(V\)에 대해 \(u_1, u_2, \cdots u_n\)이 \(V\)에 속한다고 하자. 만약 \(v \in V\)의 \(v\)들이 \(u_1, u_2, \cdots u_n\)의 선형 결합으로 "유일하게" 이뤄진다면, \({u_1, u_2, \cdots u_n}\)은 \(V\)의 basis이다.

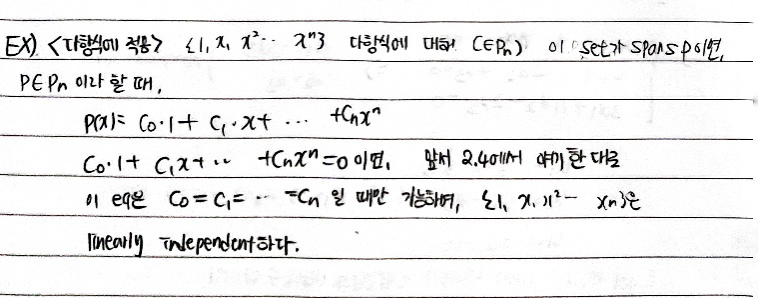

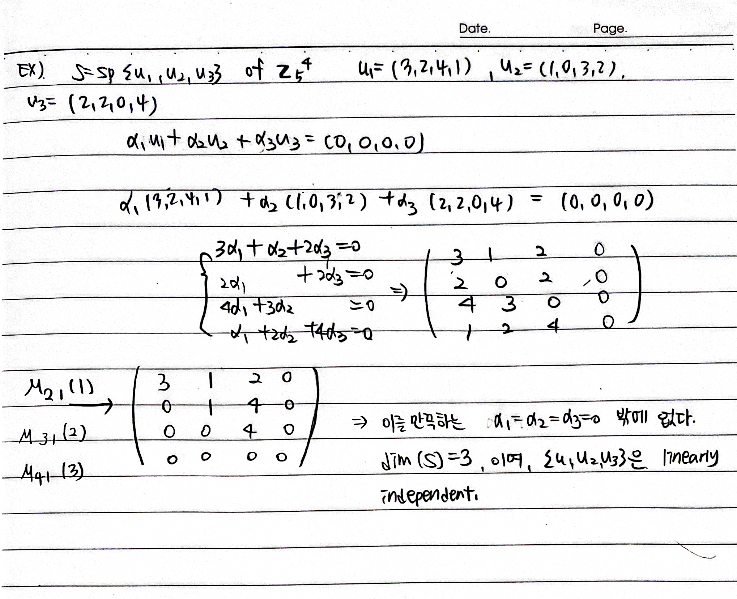

이에 대한 example을 보자.

교수님께서 앞으로 배울 내용 중에 kernel 이라는 개념과 image라는 개념을 미리 제시해주셨는데, 이는 간단하게 kernel은 null space로 N(T)로 선형 변환(T: V->W, 벡터 V에서 W로 선형 변환)에 대한 상이 0인 V의 모든 벡터 집합이라는 의미이다. Image는 T의 모든 함숫값의 집합으로 그냥 y=f(x)에서 y의 역할, 치역의 역할이라 생각하면 이해하기 쉽다. subspace나 이런 개념은 3장의 선형 변환에서 자세히 다룰 것이며, 마지막에 번외로 정리하니 밑을 참고하도록 한다.

Basis에 대해 자세히 알아보자. 벡터 공간 \(V\)의 부분집합을 \(\beta\)라고 하면, \(\beta\)가 linearly independent하고, \(V\)를 생성한다고 하면 \(\beta\)를 \(V\)의 기저(basis)라고 한다.

책에서는 점공간의 기저에 관한 정의를 제시해준다.

\(F-vector space V\)에 대하여 \(V\)가 basis를 갖거나 trivial vector space {0} 을 가지고 있으면 finitie-dimensional하고, 아니면 infinite-dimensional하다.

우리가 흔히 아는 \(R^{n}, P_n\)은 finite dimensional하다. 이에 대한 보조 정리 또한 제시해준다.

\(F- vector space V\)에 대해 \(v_1, v_2, \cdots v_n\)이 \(V\)의 nonzero vectors이고 Linealry dependent하면, \(2 \neq k \neq n\)의 정수 k가 존재한다. 그러므로 \(v_k\)을 \(v_1, v_2 \cdots v_{k-1}\)의 선형결합으로 나타낼 수 있다.

이는 이론 24에서 제시한 것과 거의 같은 맥락이다.

증명 또한 비슷하다. 다음을 참고하도록 하자.

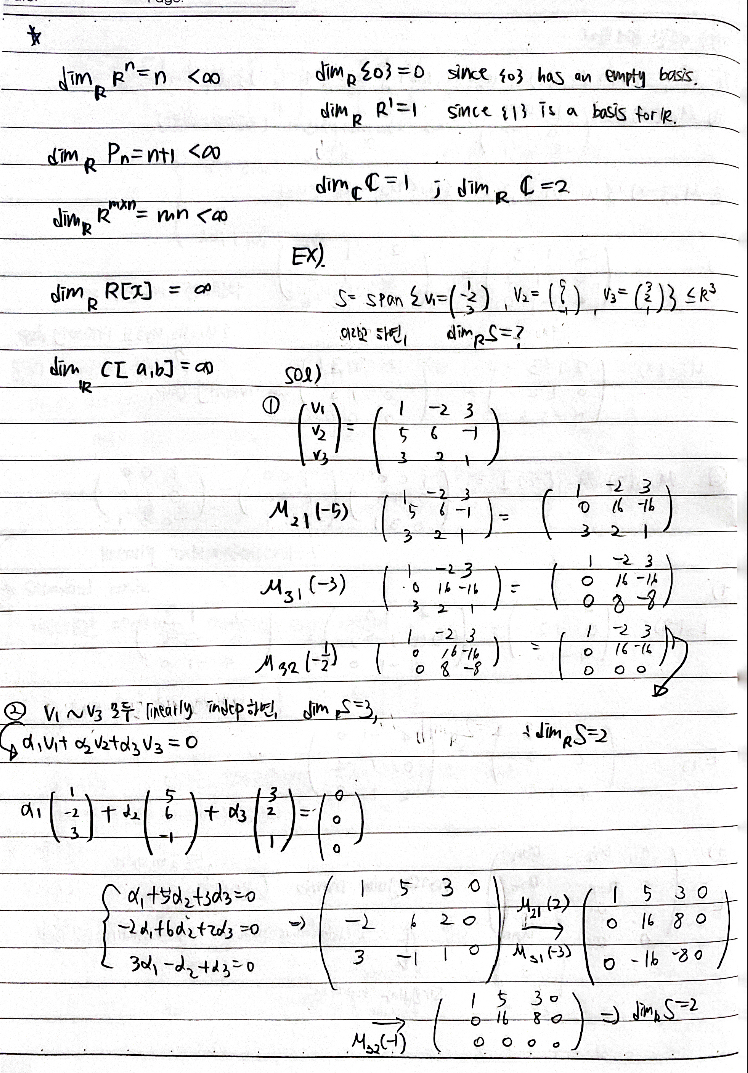

또한 dimension과 관련하여 다음 이론도 제시하였다.

\(F-vector space V\)를 finite-dimensional한 vector space라고 하고, \({u_1, u_2, \cdots u_m}\)을 \(V\)의 basis라고 하자. \(V\)에 속하는 \({v_1, v_2, \cdots v_n}\)에 대해 n>m이면, v vector set는 Linearly dependent하다.

여기까지 공부하신 분들이라면 이 이론이 무슨 의미인지 잘 알 것이다.

이론 24에 의한 것처럼 하나의 vector가 나머지 vector들의 선형 결합 조합으로 나타낼 수 있다면, 그 set는 linearly dependent한 set이다. 더 자세히 얘기해보자면, \(v_1, v_2 \cdots v_n\)이 nonzero vectors이고, \(v_1\)을 u set들의 선형 결합으로 나타낼 수 있으면, \({v_1, u_1, u_2 \cdots u_m}\)은 linearly dependent하다. 위의 보조 정리에 의해 dependent한 set에서 \(u_k\)을 나머지 vector들의 선형 결합으로 나타낼 수 있는 1이상 n 이하의 k가 존재한다. 결국, \[sp { v_1, u_1, \cdots u_{k-1}, u_{k+1}, \cdots u_m} = sp { u_1, u_2, \cdots u_m} = V\]

\(v)2\)일 때도 마찬가지로 진행하면, v set들에 대해 linearly dependent한 것이 성립한다.

이 이론을 기반으로 다음을 정의할 수 있다. 다음을 well-defined dimension이라고 한다.

\(F - vector space V\)에 대해 \({v_1, v_2, \cdots v_m} {u_1, u_2, \cdots u_n}\) 를 \(V\)의 two bases라 하면, 바로 위의 이론에 의해 m=n 이 성립한다.

또한 다음을 정의할 수 있다.

\(V\)을 finitie-dimensional vector space라고 하자. \(V\)가 trivial vector space이면, \(V\)의 dimension은 0이다.

이 벡터 공간은 항상 오직 영 벡터(모든 원소가 0인 벡터)로 구성되는 벡터 공간입니다.

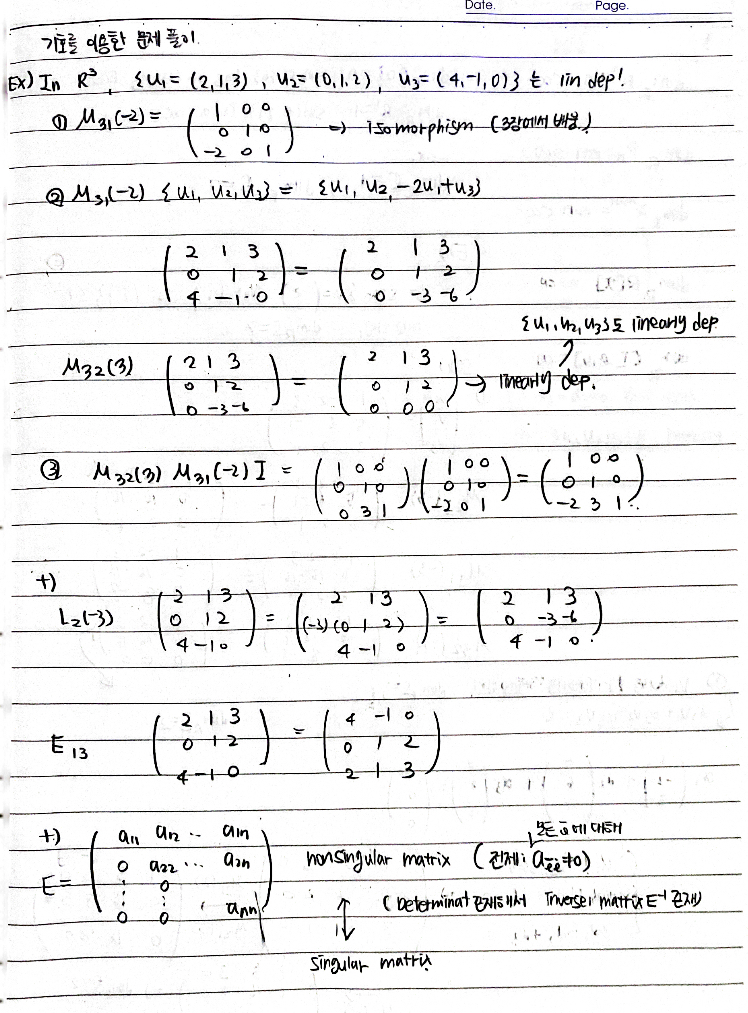

연습문제를 보기 전에 번외로 기호 및 용어를 정리하겠다.

M은 sum matrix로, M의 약자는 scalar Multiplication할 때 그때의 M이라 생각하면 쉽다.

L은 scaling matrix로, L의 약자는 Line에 숫자를 곱한다는 느낌으로 생각하면 된다.

'선형대수학' 카테고리의 다른 글

| [선형대수학] Ch 2.8 - Polynomial interpolation and the Lagrange basis (0) | 2023.10.14 |

|---|---|

| [선형대수학] Ch 2.7-Properties of bases(+3.7) (0) | 2023.10.14 |

| [선형대수학] Ch 2.5 - Linear Independence (0) | 2023.10.13 |

| [선형대수학] Ch 2.4 - Linear Combinations (0) | 2023.10.12 |

| [선형대수학] Ch2.3 - Subspaces (0) | 2023.10.12 |